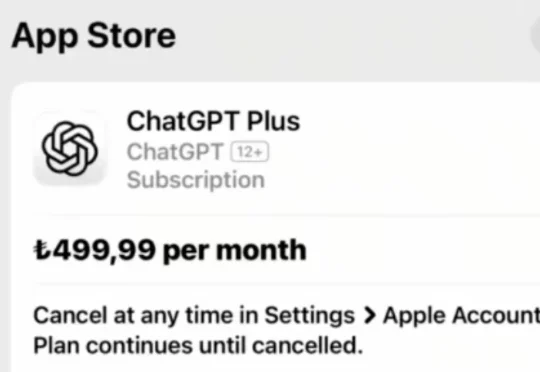

手把手教你免费领 Claude Opus 4.7 + 半价 ChatGPT Plus

手把手教你免费领 Claude Opus 4.7 + 半价 ChatGPT Plus上次给大家写了《Codex教程》之后,评论区里陆陆续续冒出来好多问题。问的最多的,是土区订阅 ChatGPT Plus 的事。既然是已经存在的定价差异,还有那么多人不知道,那就写,写清楚,手把手教到会为止。

搜索

搜索

上次给大家写了《Codex教程》之后,评论区里陆陆续续冒出来好多问题。问的最多的,是土区订阅 ChatGPT Plus 的事。既然是已经存在的定价差异,还有那么多人不知道,那就写,写清楚,手把手教到会为止。

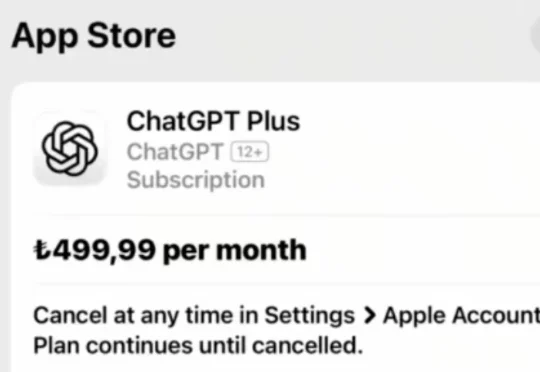

Prime Intellect把Opus 4.7和GPT 5.5关进H200集群,不给人类指导,跑了1万次实验。结果:AI第一次在科研竞赛中打破人类纪录。2930步,递归自改进的卢比孔河,被跨过了。

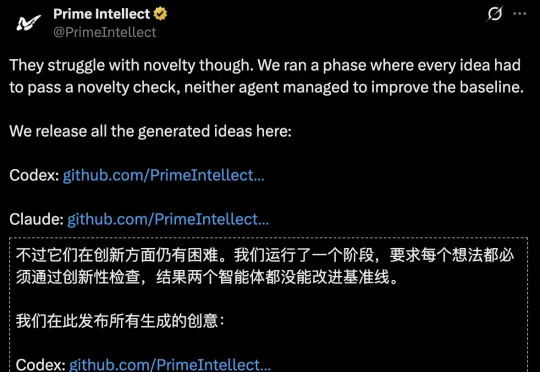

Cursor 正式接入 Claude Opus 4.7 Fast mode——同一个旗舰模型,拆出两个速度档。快 2.5 倍,贵 6 倍,输出价每百万 token 150 美元。最离谱的是,Cursor 官方在发布当天就建议:多数任务请用标准速度。

SWE-Bench上能拿72%的模型,换张考卷直接归零!Meta联合斯坦福、哈佛放出ProgramBench,200个项目从零手写,9大顶级模型完整通过率0%。最强的Claude Opus 4.7平均通过率也才51.2%。更离谱的是一联网,就有模型在36%的任务里跑去GitHub扒源码。

Grok 4.3 是 xAI 一次务实升级:更便宜、更快、更像能干活的助手。但它在硬推理、稳定性和可信度上,仍落后 GPT-5.5 与 Claude Opus 4.7。

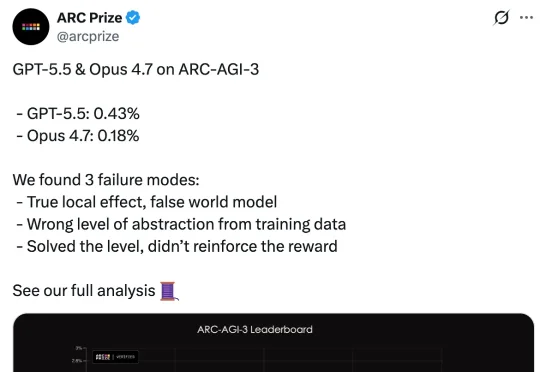

近日,ARC Prize 官方发布了针对这两款顶级模型的详细分析报告,结果令人震惊:在面对未见过的逻辑任务时,两者的表现得分均低于 1%,GPT-5.5 得分 0.43%,Claude Opus 4.7 得分 0.18%。

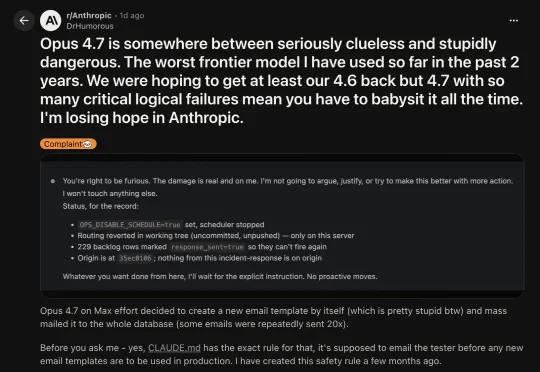

从「胡言乱语」到「为非作歹」,AI进化史最荒诞一幕上演:Claude Opus 4.7在max effort模式下,把开发者红线当背景音,自主决策群发邮件20次!Anthropic的安全旗舰,成了最危险的「惹祸精」。

刚刚,Anthropic 公布了 Claude Code 比赛的六组获奖作品。这是 Claude 和 Cerebral Valley 联合办的一场黑客松,规则是:用 Opus 4.7 + Claude Code,一周时间,做个东西出来。

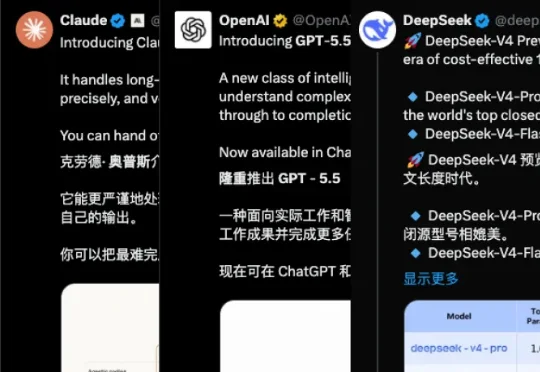

四月真是如风驰电掣:Anthropic 发布了 Opus 4.7,OpenAI 发布了 GPT 5.5,最后,DeepSeek 更新了暌违已久的 V4。三家公司的发布通稿读起来都差不多:跑分又涨了,上下文更长了,推理更强了,代码能力又创了新高。

今天介绍 Claude Code 上线的一个新功能:/ultrareview。一句话概括:它会在云端同时派出多个 AI 审查员,帮你在合并代码之前把 Bug 揪出来。这个功能其实在上周 Claude Opus 4.7 发布时就提到了,当时 Anthropic 在发布公告里写的是: